Antropomorfisme AI Generatif

Larangan pemakaian bot percakapan berbasis AI Generatif tak akan menyelesaikan masalah. Sekolah dan universitas perlu beradaptasi menghadapi kemajuan teknologi sehingga proses belajar mengajar dapat berjalan di era baru.

Ilustrasi

”With great power comes great responsibility”—Peter Parker

Peter Parker menyadari apabila ia tidak mengabaikan tanggung jawabnya, Paman Ben mungkin masih bisa hidup. Pada saat itu, Peter sangat terpukul atas kematian pamannya. Ia benar-benar belajar makna bahwa, kekuatan besar datang dengan tanggung jawab yang besar.

Perusahaan teknologi besar dunia sedang gencar melakukan pemutusan hubungan kerja kepada beberapa karyawannya karena gonjang-ganjing ekonomi dan perekrutan berlebihan selama masa pandemi. Mereka berupaya memangkas biaya di tengah ketidakpastian ekonomi dan mengalihkan fokus prioritas kepada kecerdasan buatan (AI).

Kecerdasan buatan memiliki potensi komersial dan kegunaan besar di pelbagai aspek kehidupan manusia. Namun, ada beban dan tanggung jawab kolektif untuk memastikan bahwa kecerdasan buatan yang digunakan aman dan tepercaya (safety and trustworthy).

Baca juga: Kecerdasan Buatan dan Masa Depan Kemanusiaan

Murray Shanahan, profesor bidang cognitive robotics, menjelaskan bahwa cara terbaik untuk memastikan sistem kecerdasan buatan aman dan tepercaya adalah memahami mekanisme dan cara kerjanya secara mendalam. Dengan demikian, kita dapat terhindar dari kemungkinan bahaya terburuknya serta mengambil manfaat dari kemampuan luar biasa sistem kecerdasan buatan tersebut.

Salah satu contoh sistem kecerdasan buatan adalah bot percakapan (chatbot) dari OpenAI, ChatGPT. Ia digadang-gadang dapat menggantikan peran mesin pencari, Google. Perusahaan mesin pencari tersebut bahkan sampai mengundang pendirinya–Larry Page dan Sergey Brin–untuk turun gunung menghadapi tajamnya persaingan dan ancaman disrupsi dari bot percakapan ChatGPT.

Antusiasme dan minat terhadap ChatGPT cukup besar. Kita bisa melihat banyaknya dialog yang terdokumentasi di media sosial. Fenomena antusiasme tersebut agaknya disebabkan karena ChatGPT lebih mudah diakses daripada model LLM (large language models) lainnya. Selain itu, ia juga dapat digunakan secara interaktif dan gratis.

Terlepas dari hasil yang impresif dan euforianya, ada sebagian pihak merasa khawatir dengan kemampuan bot percakapan. Terutama pada aspek yang berkaitan dengan bahasa, tulisan, dan pendidikan.

/https%3A%2F%2Fasset.kgnewsroom.com%2Fphoto%2Fpre%2F2018%2F05%2F07%2F26df801b-1f3c-426c-9d33-0f4509448e48_jpg.jpg)

Pengguna memakai chatbot Veronika, asisten virtual Telkomsel, Senin (7/5/2018). Pemanfaatan asisten virtual oleh sejumlah perusahaan mampu meningkatkan layanan konsumen, menunjang produktivitas, dan membangun kedekatan dengan pelanggan.

Mekanisme pemodelan bahasa

Filsuf bahasa, ahli logika, dan filsafat Matematika Ludwig Wittgenstein dalam Philosophische Untersuchungen mengatakan, dalam berbahasa ada tata permainan bahasa (language-game/Sprachspiel), bahasa bagi Wittgenstein adalah sesuatu yang dinamis dan cair, ia akan terus berubah berdasarkan interaksi kita dengan dunia. Selain itu, cara kita menggunakan bahasa pun dapat membentuk suatu realitas.

Dalam permainan bahasa, sebuah kata atau kalimat hanya mempunyai suatu makna ketika kita mengetahui ”aturan” dalam ”permainannya”. Oleh karena itu, untuk mengerti bahasa yang dipahami mesin dan bot percakapan, Wittgenstein menyarankan untuk mencari tahu aturan dan konsep bahasa yang digunakan dalam perangkat mesin tersebut. Bukan lagi menggunakan aturan dan konsep bahasa yang dipahami oleh manusia.

Lantas, bagaimana aturan dan permainan bahasa di mesin atau bot percakapan (chatbot)?

Bot percakapan yang paling mutakhir umumnya menggunakan large language model (LLM). Selain bisa digunakan untuk bot percakapan, LLM juga dapat digunakan untuk pembuatan teks otomatis (text generation), peringkasan berita/tulisan (summarization), pembuatan gambar dari teks (image generation), dan penerjemahan (translation).

Baca juga: ChatGPT Bakal Menenggelamkan Google

Aturan dan permainan bahasa pada bot percakapan cukup sederhana. Misalnya kita memberi input prompt berupa pertanyaan ”Siapa presiden Indonesia pertama?”, dalam aturan bahasa manusia, kita bisa langsung menjawab ”Bung Karno!”, ”Soekarno!” atau ”Penyambung Lidah Rakyat, Putra Sang Fajar!”. Namun, bagi bot percakapan, ia akan memunculkan keluaran kalimat misalnya, ”Presiden Indonesia pertama adalah Ir Soekarno.”

Dari contoh tersebut, hal yang penting untuk disadari adalah kita tidak benar-benar bertanya siapa presiden pertama Indonesia. Dalam bahasa bot percakapan, input prompt yang awalnya kita masukkan ”Siapa presiden Indonesia pertama?” akan berubah struktur dan aturan bahasanya. Prompt tersebut akan berubah menjadi sebuah perintah ke bot percakapan berupa, ”Berikan distribusi statistik, kata-kata dalam kumpulan teks (corpus) di bahasa Indonesia, dengan kata/kalimat yang paling mungkin, mengikuti urutan ‘Siapa presiden Indonesia pertama?’.”

Mesin kemudian mencari dan memberikan jawaban berdasarkan urutan kata selanjutnya yang secara statistik kemungkinannya tinggi (generate statistically likely sequences of words). Oleh karena itu, semakin spesifik pertanyaannya, kemungkinan jawabannya juga semakin tepat, hal ini tergantung juga dengan dataset yang dimiliki.

Input prompt ketika kurang spesifik, jawaban kurang tepat. Dengan demikian, bot percakapan dan LLM sebenarnya tidak ”benar-benar” tahu segala hal karena semua yang dilakukannya—pada level paling dasar—adalah prediksi urutan (sequence prediction) (Murray Shanahan, 2022).

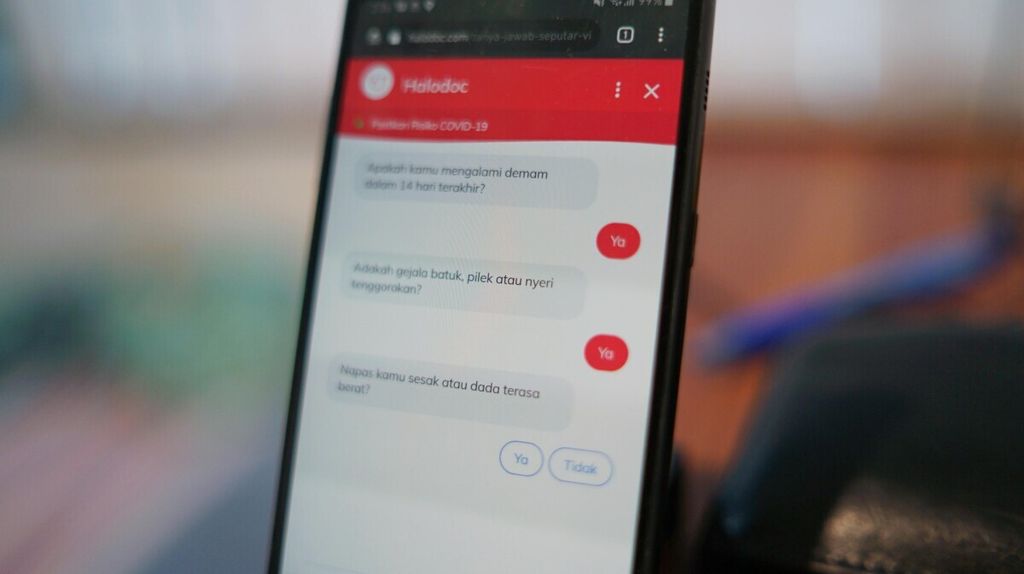

Tampilan layar chatbot Halodoc untuk mendeteksi risiko penularan Covid-19, Jumat (20/3/2020). Dengan menjawab sejumlah pertanyaan, pengguna dapat mengetahui tingkat risiko dirinya terhadap Covid-19.

Interaksi manusia

Bot percakapan ChatGPT menggunakan mekanisme Reinforcement Learning from Human Feedback (RLHF), sebuah istilah yang digunakan untuk melatih LLM. Seseorang yang bertugas melatih dan memberikan input ke model bahasa (language model) disebut prompt engineer. Ia bertugas mengevaluasi hasil model bahasa dan melatih kembali agar mesin dapat memberikan jawaban yang lebih baik.

Celakanya, ketika bot percakapan tersebut lebih baik dan pintar dari aslinya, kita seperti melihat sebuah kilasan bahwa mesin ini berperilaku layaknya manusia. Bahkan, kita memberikan atribusi karakter yang dimiliki manusia kepada entitas yang bukan manusia (antropomorfisme). Di sisi lain, antropomorfisme pada bot percakapan atau mesin juga diperlukan.

Dalam Cognitive Science dan Interaksi Manusia dan Komputer (HCI), perekayasaan (engineering) pada sebuah mesin dengan memasukkan antropomorfisme menjadi hal yang vital. Ketika mesin yang dibuat mirip seperti manusia, menarik, menghibur, dan mudah dimengerti, ia akan membangun kepercayaan dan hubungan yang lebih dekat dengan pengguna. Walhasil, pengguna dapat merasa lebih nyaman ketika berinteraksi dengan mesin tersebut (Catrambone, R, Stasko, J, & Xiao, J, 2002).

Celakanya, ketika bot percakapan tersebut lebih baik dan pintar dari aslinya, kita seperti melihat sebuah kilasan bahwa mesin ini berperilaku layaknya manusia.

Potensi permasalahan

Ketika kita hidup di mana pun kita berada, tak bisa terlepas dari komunitas global. Masalah baru di suatu negara akan bisa berdampak secara langsung pada kita saat ini, termasuk kehadiran bot percakapan seperti ChatGPT.

Di Negara Bagian New York (AS), beberapa sekolah telah melarang penggunaan ChatGPT. Namun, pelarangan teknologi agaknya tidak bisa mengatasi masalah yang ada. Oleh karena itu, Doris Wessels, professor bidang informatika bisnis dan ahli Pemrosesan Bahasa Alami (NLP), menyarankan sekolah dan universitas perlu beradaptasi dalam menghadapi kemajuan teknologi sehingga proses belajar mengajar dapat dijalankan di era yang baru.

Selain itu, ada sebuah pertanyaan yang mengganjal, kenapa kita justru melarang pelajar atau mahasiswa untuk menggunakan alat tersebut, ketika alat tersebut digunakan oleh banyak orang di luar kelas? Saya bukan ahli pendidikan, biarlah para pakar pendidikan yang berdiskusi tentang hal ini.

Selain di bidang pendidikan, bidang teknologi pun ikut terdampak. Salah satu konferensi bergengsi di bidang pembelajaran mesin, yaitu International Conference on Machine Learning (ICML), melarang paper akademik yang menyertakan hasil dari LLM seperti ChatGPT, kecuali untuk analisis hasil eksperimen. Selain itu, situs tanya jawab untuk programmer, Stack Overflow, melarang sementara penggunaan ChatGPT. Hal ini terjadi karena banyak orang menggunakan AI generatif (AI-generated) untuk menjawab pertanyaan yang ada di situs tersebut, tetapi jawabannya banyak yang salah.

Baca juga:Menuju Keseimbangan Baru

Hal yang berbahaya buat kita mungkin bukan lagi soal banjir informasi, melainkan polusi web, yaitu ketika banyak orang secara tidak bertanggung jawab menjejali web dengan konten-konten negatif dari AI generatif. Alhasil, kita tak bisa lagi memfilter dan bernapas dengan mudah di tengah banyaknya bias, kebencian, dan misinformasi yang terus-menerus direproduksi.

Di dunia yang semakin terdesentralisasi ini, peran tiap individu menjadi krusial. Kita tidak perlu menjadi Peter Parker untuk jadi adiwira. Kita bisa menjadi adiwira dengan apa yang kita punya. Caranya, dengan berperilaku bijak, dewasa, dan bertanggung jawab dalam menggunakan teknologi, terutama kecerdasan buatan yang mempunyai kemampuan tinggi.

Meskipun pada akhirnya peran kita tak dilihat oleh dunia dan dilupakan oleh semesta, sama seperti yang dialami oleh Peter Parker di film Spider-Man: No Way Home (2021). Paling tidak, setiap kalian adalah adiwira yang telah berkontribusi positif menjaga dunia nyata dan dunia digital kita.

Ahmad Mustafid, Mahasiswa Magister Computer Science RPTU Kaiserslautern, Jerman; Asisten Riset di German Research Center for Artificial Intelligence (DFKI)

Ahmad Mustafid, Mahasiswa Magister Technische Universität Kaiserslautern, Jerman