Hak Asasi di Hadapan Otomatisasi

Mengimbangi kecepatan teknologi dan melindungi hak asasi adalah hal tak terelakkan yang harus dilakukan. Untuk ini perlu kerja sama yang multidispliner antara komunitas teknis, sosial-humaniora, dan hukum.

Supriyanto

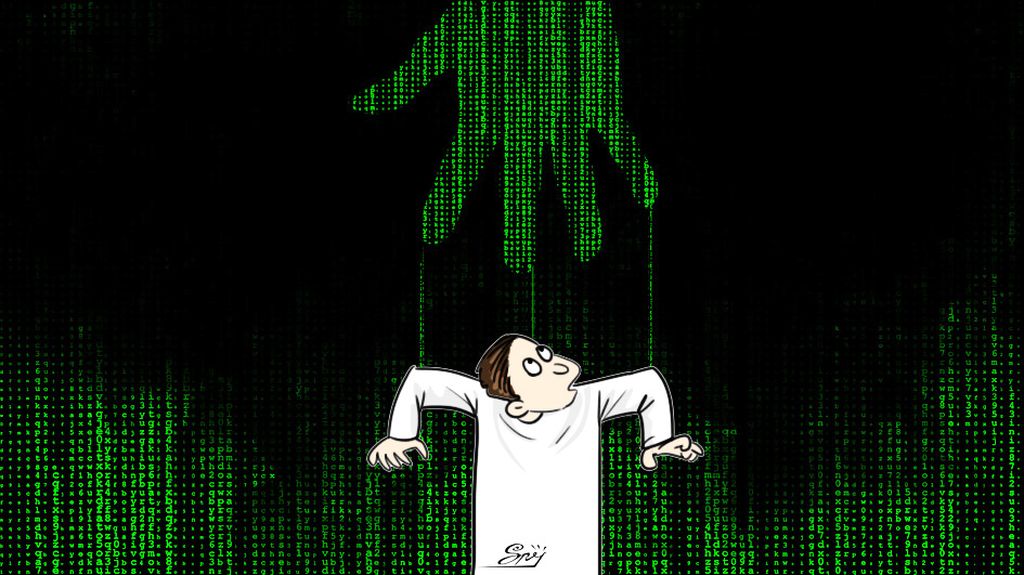

Eka Kurniawan dalam sebuah tulisannya beberapa tahun silam, suatu kali mengatakan bahwa hari ini kita tengah membangun sebuah dunia pasca-Orwellian. Ia menulis kira-kira begini, “di dunia Orwellian, dunia seperti moncong senapan yang dikendalikan kekuasaan; sekarang, semua orang diberi senapan yang bisa mengarah ke siapa pun.”

Fakta sesungguhnya: kita tidak lagi menjadi obyek yang diawasi oleh sebuah penjara panoptik, melainkan diri kita telah menjadi satu dengan struktur panoptikon itu sendiri. Panoptikonisme pasca-Orwellian itu bernafas dan hidup berkat teknologi otomatisasi yang merangkak di ruang-ruang privat kita.

Sejak Edward Snowden meniup peluit skandal program pengintaian PRISM, dunia menjadi gempar. Proyek itu menjadi satu penanda baru tentang bagaimana manusia musti menata relasinya dengan teknologi informasi, yang sudah berkembang sedemikian rupa sehingga mustahil bagi kita untuk mengasingkannya – kalau bukan melenyapkannya.

Baca juga: Bias Algoritma Mulai Bermunculan

Teknologi kecerdasan buatan yang dikembangkan sejak 1950-an telah turut mengubah proyeksi masa depan manusia, dengan mereposisi keberadaan manusia di tengah arus deras gelombang otomatisasi. Kita tak lagi perlu memisahkan malware dengan manusia karena keduanya sama-sama memiliki agensi – keduanya mampu membuat keputusan sendiri, dan tak jarang sama-sama berdaya rusak (Balzacq dan Cavelty, 2016).

Namun, bagaimana manusia me-reaksentuasikan keberadaan dirinya di hadapan automaton yang merusak, sementara kita jugalah yang menyuntikkan petaka ke dalam tubuh-tubuh mesin?

Teknologi kecerdasan buatan selalu melangkah seratus kali lebih cepat ketimbang hukum.

Dilema ini tak mampu dijawab secara pasti dan akurat oleh hukum dan kebijakan. Teknologi kecerdasan buatan selalu melangkah seratus kali lebih cepat ketimbang hukum. Di satu sisi, hukum kerap melangkah ke arah yang keliru: alih-alih melindungi, produk-produk regulatif justru menjadi opresif.

Cara pandang hukum atas kecerdasan buatan pun tak pernah mencapai konsensus. Dua dekade lalu, pengambil kebijakan mungkin enggan melangkah terlalu jauh dalam mengatur teknologi otomatisasi karena ketakutan akan menghambat inovasi. Hari ini, teknologi kecerdasan buatan melahirkan berbagai risiko – di tengah beragam terobosan, tentunya – sehingga perlu mendapat perhatian serius.

Bias teknologi

Studi-studi tentang kecerdasan artifisial telah banyak menunjukkan bahwa di tengah kehebatan dan kemutakhirannya, teknologi otomatisasi menyimpan persoalan yang musti kita akui berakar justru dari ketidakmampuan kita menciptakan ruang hidup yang aman dan bebas prasangka. Perseteruan antara Timnit Gebru, peneliti bias-bias dalam algoritma komputer, dengan eks perusahaan tempatnya bekerja, mencerminkan paraunya suara kelompok-kelompok rentan dan tak diuntungkan dalam dunia yang dibangun oleh raksasa-raksasa teknologi digital.

Ketimpangan ekonomi-politik dalam industri teknologi masa depan juga melahirkan jurang yang begitu lebar di antara negara-negara selatan dengan negara-negara utara – tempat di mana sebagian besar perusahaan teknologi besar bernaung. Kita tak bisa menampik bahwa ketimpangan semacam ini justru hanya menjadikan orang-orang di negara-negara selatan, seperti Indonesia, sebagai target – kalau bukan bulan-bulanan – dari ekses teknologi yang rasis, misoginis, bias kelas, dan heteronormatif. Kebangkitan industri teknologi China juga tak membawa kabar yang begitu menggembirakan sebab pendekatannya yang cenderung menitikberatkan pada dominasi negara menjadi ancaman serius terhadap kebebasan fundamental.

Baca juga: Teknologi Internet dan Pergeseran Orientasi Dominasi Sosial

Temuan investigasi dari konsorsium jurnalis global terhadap teknologi spyware Pegasus membunyikan denting lonceng tentang betapa mencekamnya dunia yang mengawinkan teknologi pengintaian (surveillance) dengan otoritarianisme. Seseorang tak perlu menanamkan spyware langsung di perangkat milik Jamal Khashoggi untuk dapat melacaknya, yang berujung pada kematiannya. Kita tanpa disadari dapat menjadi monster bagi orang lain karena perangkat teknologi selalu tersimpan di kantung-kantung celana atau baju yang memungkinkan siapa pun untuk mendeteksi mobilitas kita secara real-time.

Laporan Meta baru-baru ini tentang penggunaan teknologi spyware yang dikembangkan firma teknologi intelijen asal Makedonia Utara, Cytrox, juga sama mengkhawatirkannya. Selain Cytrox, Meta juga mencatat sejumlah firma teknologi serupa yang mengembangkan teknologi mata-matanya untuk pasar intelijen di berbagai negara mulai dari Arab Saudi hingga Jerman.

Facebook memperingatkan 50.000 penggunanya yang tersebar di lebih dari 100 negara tentang kemungkinan mereka menjadi target pengintaian massal ini.

Facebook memperingatkan 50.000 penggunanya yang tersebar di lebih dari 100 negara tentang kemungkinan mereka menjadi target pengintaian massal ini. Yang menjadi target pun tak jauh-jauh dari aktivis, jurnalis, dan oposisi.

Mengimbangi kecepatan teknologi dan melindungi hak asasi adalah hal tak terelakkan yang harus dilakukan. Namun demikian, langkah global dan partisipasi penuh semua komunitas diperlukan untuk memutus rantai kerusakan yang disebabkan oleh penggunaan teknologi yang opresif.

Teknologi pengenalan wajah untuk penegak hukum diperlihatkan dalam NVIDIA GPU Technology Conference di Washington, Amerika Serikat, 1 November 2017.

Hak asasi dan "automaton"

Untuk pertama kali, sebanyak 193 negara mengadopsi kesepakatan global yang merekognisi standar etik dalam pemanfaatan teknologi kecerdasan buatan. Kesepakatan ini disusun sejak 2019 oleh Kelompok Ahli Ad Hoc bentukan UNESCO untuk menyoroti dampak-dampak penetrasi teknologi kecerdasan buatan terhadap kebebasan fundamental, keberlanjutan pembangunan sosial, dan hak asasi manusia.

Sebelumnya, Facebook memperingatkan 50.000 penggunanya yang tersebar di lebih dari 100 negara tentang kemungkinan mereka menjadi target pengintaian massal ini. seperti teknologi pelacakan wajah (face-scanning) di tempat-tempat umum. Melalui konsep kota cerdas (smart city), kota-kota metropolitan di seluruh dunia, termasuk di Indonesia, memang telah mengintegrasikan pemanfaatan teknologi pengenalan wajah pada CCTV untuk menekan tingkat kriminalitas atau sekadar mengendalikan ketertiban di ruang-ruang publik.

Facebook memperingatkan 50.000 penggunanya yang tersebar di lebih dari 100 negara tentang kemungkinan mereka menjadi target pengintaian massal ini.

Beberapa negara bagian di Amerika Serikat, telah resmi melarang penggunaan pengenalan wajah oleh polisi. Parlemen Eropa juga berencana mengatur larangan serupa.

Dalam dua dekade terakhir, PBB juga telah mengadopsi berbagai resolusi untuk memberikan penekanan tentang pentingnya negara agar melakukan pencegahan dini atas penggunaan berbagai perangkat pengintai yang mengancam kebebasan dan hak-hak fundamental. Resolusi-resolusi tersebut, yang utamanya fokus pada perlindungan privasi, kebebasan berekspresi, dan kebebasan bergerak, menawarkan operasionalisasi baru untuk memastikan penggunaan teknologi masa depan selalu bertujuan untuk memajukan dan melindungi penikmatan atas hak asasi manusia.

Pendekatan tekno-sentris terhadap teknologi harus mulai digantikan dengan cara pandang yang menitikberatkan tata kelola teknologi yang berorientasi pada manusia (human-centric approach). Hal ini perlu dilakukan dengan terlebih dahulu membuang asumsi tradisional tentang teknologi yang bebas nilai dan netral. Karena sejatinya teknologi pun menumpuk lapisan-lapisan stigma dan diskriminasi yang perlu diatasi, sama halnya saat kita berupaya memperkecil ketimpangan relasi kuasa di dalam masyarakat yang plural.

Baca juga: Memandang Revolusi Peradaban Masyarakat 5.0 dari Perspektif Indonesia

Persoalan otomatisasi dan ketimpangan sosio-ekonomi-kultural tidak dapat dijelajahi hanya dengan mengandalkan pengetahuan teknis belaka, tanpa memedulikan aspek-aspek etis yang sejatinya perlu didekati dengan langkah-langkah sosio-legal. Oleh karena itu, pengarusutamaan hak asasi manusia dalam teknologi otomatisasi perlu kerja sama yang multidispliner antara komunitas teknis, sosial-humaniora, dan hukum.

Langkah-langkah legal-formal belaka hanya mampu mengoptimalisasikan keberdayagunaan teknologi untuk satu atau dua dekade mendatang. Namun membangun peradaban teknologi masa depan adalah upaya berkelanjutan yang melampaui sekat-sekat teknikalitas dan proseduralisme. Ruang-ruang dialog yang multipihak perlu dipelihara agar lahir metode-metode baru yang terus melestarikan keragaman di tengah pertumbuhan teknologi yang cepat.

Sophia, robot yang didukung dengan teknologi kecerdasan buatan yang diaktifkan pada 2016 dan diciptakan oleh perusahaan Hanson Robotics yang berbasis di Hong Kong, saat melakukan wawancara khusus dengan media pada ”2019 CSIS Global Dialogue”, di Jakarta, Senin (16/9/2019).

Neo-otoritarianisme

Para ahli menyebut Indonesia tengah melaju ke gaya baru otoritarianisme (Mietzner, 2019 – “innovative authoritarian”; Morgenbesser, 2020 – “sophisticated authoritarian”). Salah satu sinyalemen itu diperlihatkan, salah satunya, dari terus menurunnya kualitas kebebasan berinternet di Indonesia sejak 2016 berdasarkan laporan Freedom House.

Dalam hal digitalisasi, Indonesia mengalami proses penetrasi yang relatif cepat. Penetrasi digital di Indonesia telah mencapai lebih dari 70 persen dan termasuk negara dengan tingkat adopsi kecerdasan buatan tertinggi di ASEAN. Di sisi lain, kesenjangan berbasis jender dalam kepemilikan ponsel pintar masih relatif tinggi, sekitar 10 persen, dan infrastruktur internet inklusif di Indonesia menempati posisi ke-66 dari 115 negara.

Baca juga: Dampak Kecerdasan Buatan bagi Indonesia

Ini adalah dua kenyataan dalam satu koin mata uang yang perlu diatasi. Komisioner Tinggi HAM PBB dalam laporannya tentang kecerdasan artifisial dan hak asasi manusia menyebutkan, seluruh langkah yang diambil oleh negara dalam mengatur teknologi harus kembali pada prinsip inti, yakni persamaan dan non-diskriminasi, partisipasi dan akuntabilitas, yang sekaligus menjadi jantung dalam tujuan pembangunan berkelanjutan dan Prinsip-prinsip Panduan Bisnis dan Hak Asasi Manusia.

Miftah Fadhli

Seperti yang dikatakan, teknologi otomatisasi harus digunakan dengan cara yang bermanfaat bagi perwujudan hak-hak ekonomi, sosial, dan budaya, dengan memastikan tercapainya ketersediaan, keterjangkauan, aksesibilitas, dan kualitas teknologi bagi umat manusia.

Miftah Fadhli, Peneliti Teknologi dan Hak Asasi Manusia di Lembaga Studi dan Advokasi Masyarakat (Elsam)